欢迎体验得助产品

手机号码

欢迎注册得助智能

已为您开启免费试用,全部功能任您体验

扫码添加专属客服,即时为您提供服务

注册尚未完成

现在离开将导致注册失败确定要退出吗?

填写时间过长

页面已停止响应

请在30分钟内完成填写

登录成功

请选择您感兴趣的产品

得助大模型平台

模型训练平台

模型训练平台

一站式服务简化大模型训推评全流程

智能体平台

智能体平台

高效、低成本构建大模型企业级应用

知识管理

财富助手

财富助手

为财富顾问提供一站式智能问答服务

知识助手

知识助手

组合式AI打造大模型企业知识助手

智能客服

全媒体呼叫中心

全媒体呼叫中心

全渠道全媒体、一站式AI+呼叫中心

语音机器人

语音机器人

外呼大模型加持,听得准确说得自然

文本机器人

文本机器人

即时文本对话,自研知识引擎

智能陪练

智能陪练

大模型拟真,千人千面沉浸式AI对练

智能运营

音视频服务平台

音视频服务平台

全场景自研AI+RTC实时音视频服务

OCR识别

OCR识别

高精度、高安全的图文检测识别服务

智能RPA

智能RPA

AI+RPA深度融合,赋能企业自动化

多模态防伪

多模态防伪

全链路生物数据核验,守卫安全防线

多模态质检

多模态质检

大模型赋能合规,金融级多模态质检

对话式BI

对话式BI

自然语言交互,可视化智能分析数据

企业出海

全媒体呼叫中心(海外版)

全媒体呼叫中心(海外版)

企业跨语种无界沟通,赢占国际市场

文本机器人(海外版)

文本机器人(海外版)

多语言国际服务,跨时区沟通无障碍

语音机器人(海外版)

语音机器人(海外版)

多语言智能交互助力全球营销与服务

智能质检(海外版)

智能质检(海外版)

大模型赋能国际企业多模态质检服务

智能营销

企微SCRM

企微SCRM

智能营销服引擎,高效转化私域流量

营销平台

营销平台

打通营销全链路,赋能企业增速业务

企业直播

企业直播

打造超低延迟、超稳定的直播平台

其他

通用人力外包

通用人力外包

为企业提供多场景、高质量专业服务

线路

线路

安全稳定、应用多场景的线路服务

描述具体需求(选填)

欢迎微信扫码咨询

中关村科金得助智能-小得

选型指南

2025-06-17 15:15:00

作者:JIfan

阅读量:498

文章目录

如今不少企业都在利用大模型赋能业务,提升企业的竞争力,因此部分大型国企、私企都想进行私有化大模型部署,因此需要用到不少的私有化大模型训练工具来对智能客服、问答助手、知识库进行智能化升级。一般来说API接口工具可以用llama.cpp、Ollama、LM Studio、vLLM,开发平台建立本地知识库可以用中关村科金得助智能知识助手、Dify、AnythingLLM、HiAgent,下面具体来看看吧!

现在的大语言模型几乎都是用聊天来和用户互动的,因此我们想要进行私有化大模型训练,一般会用到智能问答助手作为私有化切入点,他也具有三大优势:

业务适配性:可以整合企业内部的知识库、文档数据,训练出一个专属问答系统(比如说智能客服、内部培训助手);

技术成熟度:利用检索增强生成(RAG)、向量数据库等技术,容易形成标准化解决方案;

成本可控性:相比全场景应用,问答场景对模型算力要求更少,可在消费级硬件(如笔记本、GPU服务器)上部署。

私有化大模型训练工具在选择的时候要结合应用场景性能需求、客观硬件条件、易用性及生态支持等多维度评估。以问答助手为例,大模型私有化部署可以分为前端和后端两部分,下面介绍当前主流工具和网站。

私有化部署时,我们首先要本地拉起一个大模型,通过API的形式提供给上层应用调用。下面是一些常用的LLM部署管理工具。

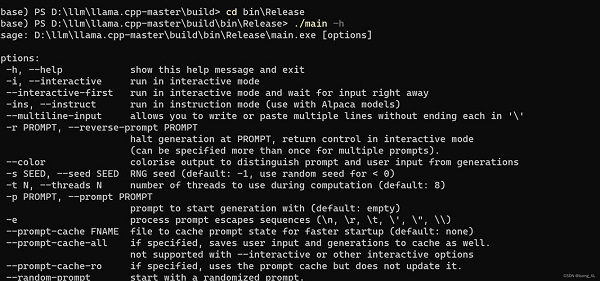

1.llama.cpp

llama.cpp是一个基于C/C++编写的开源推理框架,专为在本地CPU/GPU环境高效运行LLM大语言模型而设计。其核心目标是降低LLM的部署门槛,通过量化技术与硬件优化,实现在消费级设备(如笔记本电脑、树莓派甚至手机)上运行类ChatGPT模型。llama.cpp是本地运行LLM的“瑞士军刀”,凭借其高效性与跨平台能力,成为个人开发者和硬件受限场景的首选工具。对于追求开箱即用的用户,可结合Ollama或LM Studio简化操作。

2.Ollama:适合快速验证测试性部署

Ollama是轻量级本地模型管理框架,基于llama.cpp进行封装,提供更友好的命令行体验和模型仓库,支持快速部署和运行主流开源模型(如Llama3、Qwen2、DeepSeek等)。Ollama需要使用命令行进行操作,命令风格与Docker/podman极其类似,如果之前就熟悉docker,可以做到无缝切换。

其主要特点有:

简化部署:Ollama目标在于简化在Docker容器中部署大语言模型的过程,使得非专业用户也能方便地管理和运行这些复杂的模型。

轻量级与可扩展:作为轻量级框架,Ollama保持了较小的资源占用,同时具备良好的可扩展性,允许用户根据需要调整配置以适应不同规模的项目和硬件条件。

3.LM Studio:适合非技术用户

LM Studio无需复杂命令行操作,前后端集成,是最简单的本地测试AI模型的工具,不需要安装python环境以及众多的组件,加载模型、启用GPU、聊天都非常简单。而且可以切换很多不同类型的大语言模型,同时支持在Windows和MAC上的PC端部署。使用LM Studio不需要深厚的技术背景或复杂的安装过程。传统上,本地部署大型语言模型如Lama CPP或GPT-4ALL往往伴随着繁琐的安装步骤和环境配置,这对技术要求极高。然而,LM Studio的出现彻底改变了这一局面。它提供了一个简单的安装程序,用户只需几个简单的步骤就可以轻松安装和运行。

4.vLLM:企业级高性能推理框架

vLLM是一个专注于高效推理和服务的大模型库,由加州大学伯克利分校的研究团队开发,专为GPU高并发设计,性能优于llama.cpp。它采用了一种称为PagedAttention的技术,优化了显存管理,特别适合高并发场景,例如部署大模型API服务(如智能客服、内容生成平台),需要处理大量并发请求。非企业专业用户一般用不到。

部署完私有化LLM大模型及其服务管理工具,已经能通过API的形式对外提供服务了。但是对于私有化部署来说,我们需要定制化实现私有知识库,比如通过RAG、工作流、插件、函数库等功能,构建具有实现本地定制化、完成特定的任务的应用。

因此,下一步需要有一个开发平台,建立本地知识库,提供RAG、联网搜索、工作流、用户管理、审计功能、可观测性等功能的总和应用开发与集成平台。下面列举具有此类功能的常用产品。

1.中关村科金得助智能知识助手

是一款基于大语言模型和RAG的知识库,拥有多模态文档上传解析、实时精准解答、自动总结归纳、支持本地化部署与RAG优化,广泛应用于智能客服、企业内部知识库、学术研究与教育等场景。

合作案例:中关村科金得助智能联合中船综合院共建船舶工业大模型平台,通过构建领域大模型基础平台和大模型训练数据体系,助力中船综合院构建行业级大模型底层能力,为中国船舶行业产业链参与主体创造价值。通过智能问答、公文写作、情报分析、报告生成、构建知识库等核心能力,应用于5大类16个细分业务场景,提升工作效能和企业运营效率,推动船舶先进制造技术成果推广,有力支撑新型工业化与造船强国建设。

得助智能知识助手免费试用14天

2.Dify

Dify是一款低代码可视化AI应用开发平台(智能体平台),支持知识库与模型服务私有化部署。支持多模型混合编排(本地+云端API),内置50+Agent工具链。提供RAG流程设计、知识库管理和LLMOps监控功能。开源版本支持私有化部署,适合低代码开发,适用于企业快速构建AI应用(如智能客服)。

3.AnythingLLM

企业级文档问答专用平台,支持多工作区权限管理,内置文档分块和向量化存储,数据完全本地化,适合敏感信息处理,但是复杂问题回答深度不足。而且是英文环境,对国内用户使用不是很友好。

4.HiAgent

HiAgent是字节旗下的火山引擎推出的一款企业专属AI应用创新平台涵盖政务、企业服务、内容创作等场景。

除了上述技术方案,在部署训练过程中,我们还会用到各种网站和工具,主要有:

模型社区网站

模型社区提供各种开源大模型的下载,类似于github,主流的模型社区有以下两个:

Hugging Face:国外开源模型社区,类似于github。

魔搭社区ModelScope:阿里云开源模型社区,类似于码云,侧重中文模型。

如果是小型企业进行私有化大模型训练,可以用Ollama+MaxKB/Dify工具进行搭建,如果是中大型企业可以用中关村科金得助智能进行部署,提供完善的私有化解决方案。私有化大模型训练工具的本质是“让模型成为企业专属的智能大脑”,通过合理的选择,任何企业都可以应用到大模型的能力。

企业积累的文档、报告、经验等知识资产呈指数级增长。如何将这些沉睡的数据转化为驱动业务增长的动能,成为每个管理者面临的课题。面对市场上众多的选择,知识管理软件怎么选才能真正为企业提效降本?答案在于,它是否能够跨越传统工具的局限,实现从“知识存储”到“智能应用”的跨越。一款优秀的软件,不应仅是文档的仓库,更应是企业智慧的放大器。

对于银行以及金融机构来讲,面临数量众多的合规文档、繁杂的业务流程以及严格的数据安全要求,挑选一款恰当的知识管理工具越发显得重要。那么,2026年处于知识管理软件排名榜前十的都有哪些呢?这些产品分别拥有哪些特点以及适用场景呢?本文会为您进行全面的盘点。

在金融行业数字化转型的浪潮中,AI知识库平台型应用正从“辅助工具”进化为“业务中枢”。对银行、证券、保险等企业的从业者而言,这类产品早已不是简单的文档管理系统,而是承载着风险管控、合规审查、客户服务等核心职能的“智能大脑”。本文将结合金融企业真实痛点,拆解ai知识库平台型应用产品的核心是什么?多模态解析+动态知识网络+场景化适配。

各位企业从业者在接触智能服务工具时,很容易有个疑问:智能知识库具备智能客服机器人吗?今天咱们先把这个核心问题说透 ——智能知识库本身并不具备智能客服功能。它更像是一个 “超级知识仓库”,专门存储企业的各类文档、业务知识、数据资料,既可以供内部员工查询使用,也能作为智能客服机器人的 “知识来源”,为机器人提供解答客户问题所需的素材和依据。 简单来说,智能知识库是 “幕后的智慧储备”,智能客服是 “台前的服务执行者”,二者是协作关系,而非包含关系。下面咱们就分别聊聊这两款产品,看看它们各自能帮企业解决哪些问题。

在当今快速变化的商业环境中,国企作为国家经济的支柱,正面临着前所未有的挑战与机遇。为了提升管理效率、促进知识共享与创新,知识库管理系统(KBMS)逐渐成为国企数字化转型的关键工具。本文将深度解析知识库管理系统定义、功能作用、搭建方案、费用价格,为国企从业者提供一份详尽的知识库指南。

10款热门知识管理软件深度解析:从得助智能的多模态文档解析到ONES的团队协作设计,Confluence的高度可定制性,Notion的全能生产力,再到SharePoint的企业级安全性。探索如何借助大模型技术实现高效知识提取、智能问答与精准推荐,助力企业构建智能化知识图谱体系,驱动业务创新与决策升级。